Deepfake e politica: il caso Giorgia Meloni e il rischio di una realtà manipolata

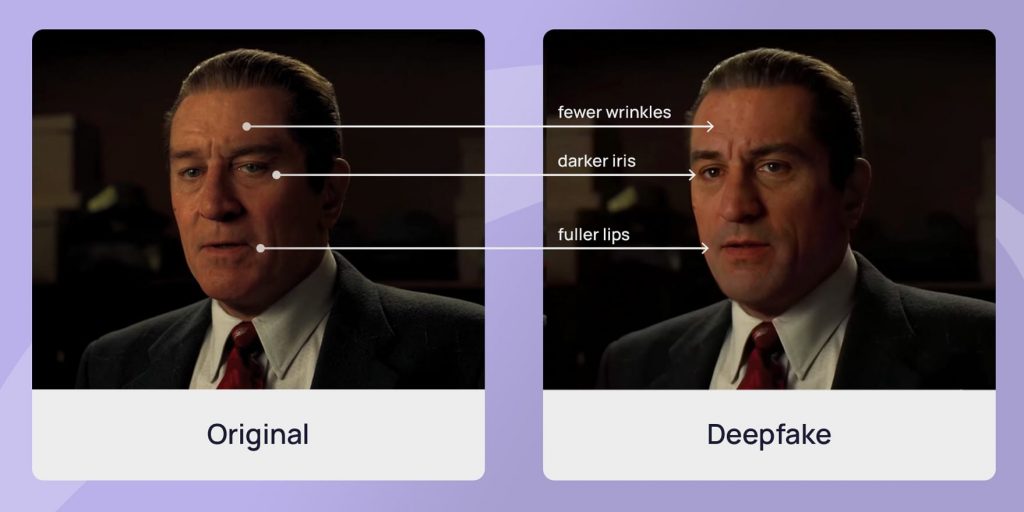

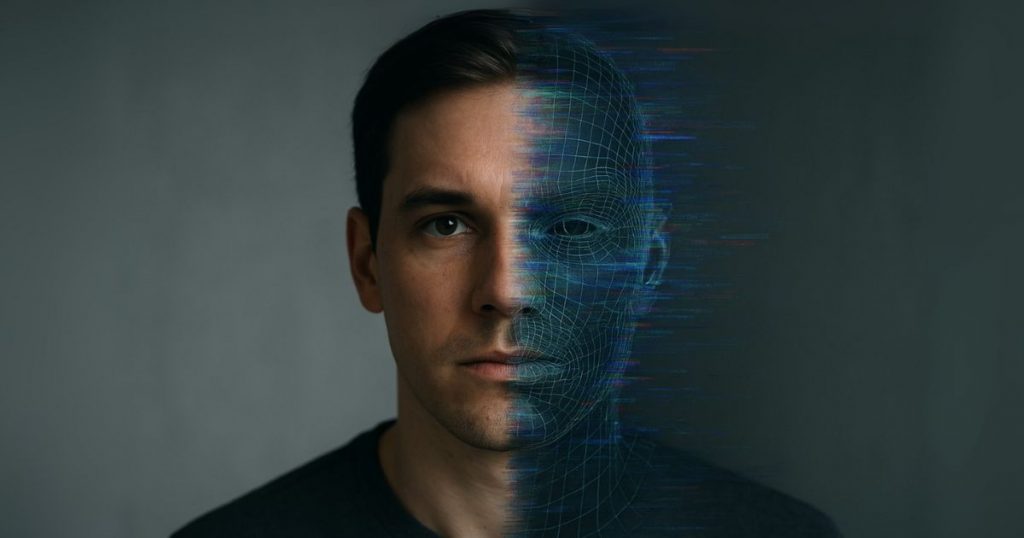

Negli ultimi anni il termine deepfake è entrato con sempre maggiore frequenza nel dibattito pubblico, ma non sempre è chiaro cosa significhi davvero. Con questa parola si indicano contenuti, immagini, video o audio, generati o manipolati attraverso l’intelligenza artificiale in modo così realistico da sembrare autentici. Non si tratta più di semplici fotomontaggi: i deepfake sono costruiti con tecnologie avanzate che riescono a replicare volti, voci ed espressioni con una precisione tale da ingannare anche uno sguardo attento.

Il problema non è solo tecnico, ma profondamente politico e sociale. I deepfake mettono in discussione uno dei presupposti fondamentali della comunicazione contemporanea: la fiducia nelle immagini. Se tutto può essere falsificato con estrema facilità, allora nulla è più immediatamente credibile. Ed è qui che il rischio diventa concreto, soprattutto quando queste tecnologie vengono utilizzate per colpire figure pubbliche, manipolare l’opinione pubblica o diffondere contenuti falsi con intenti denigratori.

La pericolosità dei deepfake sta nella loro capacità di diffondersi rapidamente e di lasciare un segno anche dopo essere stati smentiti. Una volta che un’immagine o un video falso diventa virale, il danno è già fatto. Anche quando viene dimostrato che si tratta di un contenuto manipolato, resta una traccia nella percezione collettiva, un dubbio che difficilmente si cancella.

Nel caso delle donne, il fenomeno assume spesso una dimensione ancora più violenta: molti deepfake vengono utilizzati per creare immagini intime o sessualizzate senza consenso, trasformando la tecnologia in uno strumento di umiliazione pubblica. Non è solo disinformazione, ma una forma di abuso digitale che colpisce la reputazione, la dignità e, in alcuni casi, anche la sicurezza personale delle vittime.

Le leggi: siamo davvero protetti?

Sul piano normativo, il tema dei deepfake è ancora in una fase di transizione, e il caso italiano lo dimostra chiaramente. Ad oggi non esiste una normativa specifica e strutturata che affronti in modo diretto il fenomeno, anche se alcune leggi già esistenti, come quelle sulla diffamazione o sulla diffusione illecita di immagini, possono essere applicate. Il problema è che questi strumenti risultano spesso insufficienti di fronte a una tecnologia così rapida e sofisticata.

Proprio attorno al caso che ha coinvolto Giorgia Meloni si è riacceso il dibattito politico. Alla presidente del Consiglio sono arrivate attestazioni di solidarietà trasversali, ma non sono mancate critiche anche molto dirette. Anna Ascani, esponente del Partito Democratico e vicepresidente della Camera, ha sottolineato come il governo abbia affrontato il tema con un approccio ritenuto limitato, basato principalmente sull’introduzione di un nuovo reato, senza però costruire un sistema davvero efficace di prevenzione e intervento.

Il riferimento è alla legge approvata nel settembre 2025, che secondo alcune voci dell’opposizione non sarebbe sufficiente a contrastare il fenomeno. Il punto centrale della critica riguarda l’assenza di strumenti operativi immediati: manca, ad esempio, una normativa che consenta alle autorità di intervenire rapidamente chiedendo alle piattaforme digitali la rimozione tempestiva dei contenuti deepfake, soprattutto quando questi rischiano di alterare il dibattito pubblico o influenzare l’opinione degli elettori durante le campagne politiche.

Ascani ha inoltre ricordato come manchi proprio «una legge che permetta alle autorità preposte di chiedere alle piattaforme la rimozione immediata di contenuti di questo tipo, soprattutto quelli che inquinano il dibattito pubblico e la formazione del consenso in particolare in campagna elettorale. E questa legge non esiste perché questo esecutivo non l’ha voluta: la mia pdl per contrastare gli usi distorti di contenuti prodotti con l’intelligenza artificiale diffusi sui social è stata bocciata proprio dal suo governo, nell’imbarazzo della maggioranza che in Parlamento balbettava sorpresa dalla chiusura totale su una questione che riguarda tutti ed è interesse di tutti».

A livello europeo, intanto, il tema è al centro di un confronto più avanzato. Le istituzioni dell’Unione stanno lavorando a regolamenti sull’intelligenza artificiale che includano anche obblighi di trasparenza per i contenuti generati artificialmente e responsabilità più chiare per le piattaforme. Ma anche qui resta aperta una questione fondamentale: la capacità delle leggi di stare al passo con una tecnologia che evolve molto più velocemente della politica.

Il caso Giorgia Meloni: quando la politica diventa bersaglio

In questo contesto si inserisce il caso che ha coinvolto Giorgia Meloni, finita al centro di una campagna di immagini false generate con l’intelligenza artificiale. Negli ultimi giorni, online hanno iniziato a circolare contenuti manipolati che la ritraggono in situazioni intime, completamente inventate, costruite con tecniche di deepfake.

La stessa Meloni ha denunciato pubblicamente l’accaduto, parlando apertamente della diffusione di “mie foto false generate con l’IA” e sottolineando come “i deepfake sono una minaccia” concreta non solo per chi li subisce direttamente, ma per l’intero sistema democratico. Le immagini, in particolare, la ritraevano in lingerie, un dettaglio che rende evidente la natura non solo politica ma anche sessista dell’attacco.

«Girano in questi giorni diverse mie foto false, generate con l’intelligenza artificiale e spacciate per vere da qualche solerte oppositore. Devo riconoscere che chi le ha realizzate, almeno nel caso in allegato, mi ha anche migliorata parecchio. Ma resta il fatto che, pur di attaccare e di inventare falsità, ormai si usa davvero qualsiasi cosa. Il punto, però, va anche oltre me. I deepfake sono uno strumento pericoloso, perché possono ingannare, manipolare e colpire chiunque. Io posso difendermi. Molti altri no. Per questo una regola dovrebbe valere sempre: verificare prima di credere e credere prima di condividere. Perché oggi capita a me, domani può capitare a chiunque».

Non è un caso isolato, ma è uno dei più evidenti esempi di come queste tecnologie possano essere utilizzate per colpire figure istituzionali. Il fatto che si tratti della Presidente del Consiglio rende la vicenda ancora più significativa: se può succedere a una delle persone più esposte e tutelate del Paese, può succedere a chiunque.

Ridurre il caso Meloni a un episodio di gossip digitale sarebbe un errore. Qui non si tratta solo di immagini false, ma di un attacco che utilizza strumenti tecnologici avanzati per delegittimare una figura pubblica, sfruttando dinamiche che mescolano politica, sessualizzazione e disinformazione. Il Parlamento europeo ha già iniziato a discutere il tema, con una risoluzione che richiama l’attenzione proprio sull’uso dei deepfake in ambito politico. L’obiettivo è quello di riconoscere il problema come una minaccia concreta e di intervenire con strumenti normativi più efficaci, soprattutto considerando che spesso le vittime sono anche delle minorenni. A volte delle bambine.

Il caso di Giorgia Meloni dimostra che siamo entrati in una nuova fase della comunicazione digitale, in cui il confine tra vero e falso è sempre più difficile da distinguere. I deepfake non sono più una curiosità tecnologica, ma un’arma che può essere utilizzata per manipolare, colpire e destabilizzare. E la domanda, a questo punto, è inevitabile: siamo pronti ad affrontare questa nuova realtà? Perché se la tecnologia continua a evolversi a questo ritmo, il rischio è che la verità diventi sempre più fragile, e che difenderla richieda strumenti, sia culturali che politici che legislativi, che ancora non abbiamo del tutto costruito.

Girano in questi giorni diverse mie foto false, generate con l’intelligenza artificiale e spacciate per vere da qualche…

Pubblicato da Giorgia Meloni su Martedì 5 maggio 2026

Giulia, 27 anni, laureata in Filologia Italiana con una tesi sull'italiano standard e neostandard, "paladina delle cause perse" e insegnante di Italiano Lingua non materna. Presidente di ESN Perugia e volontaria di Univox. Amo scrivere, leggere, guardare serie tv e anime, i gatti e seguire le giuste polemiche. Instagram: @murderskitty